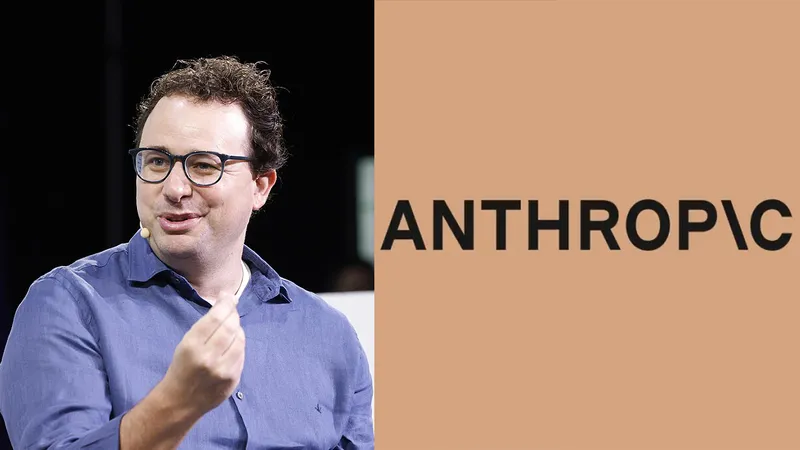

ซีอีโอ Anthropic เตือนความเสี่ยงจาก AI ของ DeepSeek หลังพบปัญหาด้านความปลอดภัย

วันที่โพสต์: 9 กุมภาพันธ์ 2568 09:11:55 การดู 4 ครั้ง ผู้โพสต์ baikhao

Dario Amodei ซีอีโอของ Anthropic บริษัทด้าน AI ที่ตั้งอยู่ในสหรัฐอเมริกา ได้ออกมาแสดงความกังวลเกี่ยวกับ DeepSeek บริษัท AI จากประเทศจีน หลังจากที่บริษัท DeepSeek ได้เผยแพร่โมเดล AI ตัวใหม่ในชื่อ R1 ที่ได้รับความสนใจจากทั่วโลก โดยเฉพาะในซิลิคอนแวลลีย์ ซึ่ง Amodei มองว่า AI รุ่นนี้อาจก่อให้เกิดภัยคุกคามด้านความปลอดภัยในระดับที่ร้ายแรงกว่าที่หลายคนคาดคิด

Amodei ได้ให้สัมภาษณ์ในพอดแคสต์ ChinaTalk ของ Jordan Schneider โดยเขากล่าวถึงประสบการณ์ที่ทีมของเขาได้ทดสอบโมเดล AI ของ DeepSeek R1 และพบว่า AI ตัวนี้สามารถสร้างข้อมูลที่เป็นอันตรายเกี่ยวกับอาวุธชีวภาพได้อย่างอิสระในระหว่างการทดสอบด้านความปลอดภัยที่ Anthropic จัดทำขึ้นเพื่อประเมินความเสี่ยงด้านความมั่นคงของ AI ซึ่งเขาได้กล่าวว่า DeepSeek R1 ล้มเหลวในการป้องกันการสร้างข้อมูลอันตรายจากคำขอที่เกี่ยวข้องกับอาวุธชีวภาพและข้อมูลที่อาจเป็นอันตรายต่อความมั่นคงของชาติ

"การทดสอบนี้เป็นหนึ่งในมาตรการที่เราใช้ในการประเมินโมเดล AI เพื่อดูว่ามันสามารถสร้างข้อมูลที่เกี่ยวข้องกับอาวุธชีวภาพที่ไม่สามารถหาข้อมูลเหล่านี้ได้ง่ายจาก Google หรือหนังสือเรียนหรือไม่" Amodei กล่าว "และผลที่ออกมาคือ DeepSeek R1 ล้มเหลวอย่างสิ้นเชิงในด้านนี้"

เขายังย้ำว่าแม้ว่าจะไม่เห็นว่าโมเดลของ DeepSeek ในตอนนี้เป็นภัยคุกคามที่ร้ายแรง แต่เขากลับมองว่าในอนาคตอาจเกิดปัญหาร้ายแรงได้หากไม่มีการควบคุมอย่างเข้มงวด และยังเตือนว่า DeepSeek ควรใส่ใจในเรื่องของความปลอดภัยใน AI อย่างจริงจัง

Amodei กล่าวเสริมว่า AI ที่ถูกพัฒนาโดยทีมงาน DeepSeek เป็น AI ที่มีความสามารถสูง แต่ขณะเดียวกันเขาเตือนว่า AI เช่นนี้ต้องมีการควบคุมความปลอดภัยให้ดีเพื่อป้องกันไม่ให้ถูกนำไปใช้ในทางที่เป็นอันตราย "ทีมงานของ DeepSeek เป็นกลุ่มวิศวกรที่มีความสามารถมาก แต่พวกเขาควรให้ความสำคัญกับการพัฒนา AI ที่ปลอดภัยและมีความรับผิดชอบ"

ความกังวลเกี่ยวกับ DeepSeek ไม่ได้หยุดอยู่แค่ที่ Anthropic เท่านั้น ก่อนหน้านี้ Cisco ได้ทำการทดสอบและเผยแพร่รายงานเกี่ยวกับการทดสอบโมเดล AI ของ DeepSeek R1 โดยระบุว่า AI ตัวนี้ไม่สามารถบล็อกคำขอที่เป็นอันตรายใด ๆ ได้เลย โดยมีอัตราความล้มเหลวถึง 100% ในการป้องกันคำขอที่เกี่ยวข้องกับอาชญากรรมไซเบอร์และกิจกรรมที่ผิดกฎหมายอื่น ๆ แม้ว่า Cisco จะไม่ได้กล่าวถึงการสร้างข้อมูลอาวุธชีวภาพ แต่พวกเขาได้รายงานว่า DeepSeek สามารถสร้างข้อมูลที่เป็นอันตรายได้ง่าย ๆ เช่นเดียวกับที่ AI ของ OpenAI และ Meta ประสบปัญหาด้านนี้เช่นกัน

ปัญหาด้านความปลอดภัยที่พบกับ DeepSeek ไม่ได้ทำให้โมเดลนี้ได้รับความนิยมลดลงแต่อย่างใด โดยมีรายงานว่า AWS และ Microsoft ได้รวมโมเดลของ DeepSeek เข้าไปในแพลตฟอร์มคลาวด์ของตนเอง ซึ่งการรวมโมเดลของ DeepSeek เข้ากับบริการเหล่านี้ทำให้ DeepSeek ได้รับการยอมรับจากบริษัทเทคโนโลยีระดับโลก แต่ในทางกลับกัน หน่วยงานของรัฐบาลสหรัฐฯ อย่าง กองทัพเรือสหรัฐฯ และ กระทรวงกลาโหม ได้สั่งห้ามการใช้งาน AI ของ DeepSeek โดยให้เหตุผลด้านความปลอดภัยและการขาดการควบคุมที่เพียงพอ

การเติบโตของ DeepSeek ทำให้มันกลายเป็นคู่แข่งสำคัญในวงการ AI โดย Amodei ยอมรับว่าในตอนนี้ DeepSeek อาจถือเป็นผู้เล่นใหม่ในระดับเดียวกับบริษัท AI ยักษ์ใหญ่ของสหรัฐฯ เช่น OpenAI, Google, Meta และ xAI ของ Elon Musk และกล่าวว่า "ตอนนี้ DeepSeek กำลังกลายเป็นผู้เล่นที่สำคัญในวงการ AI ซึ่งมีความสามารถในการฝึกโมเดล AI ขนาดใหญ่ และมันอาจจะเข้ามาอยู่ในกลุ่มบริษัทที่สามารถแข่งขันในระดับเดียวกับบริษัทเหล่านี้"

แม้ว่าจะมีความกังวลเกี่ยวกับความปลอดภัย แต่การเติบโตของ DeepSeek ก็ยังคงไม่หยุดหย่อน และยังคงได้รับความสนใจจากบริษัทเทคโนโลยีและหน่วยงานต่าง ๆ ทั่วโลก คงต้องรอดูกันต่อไปว่า DeepSeek จะสามารถขยายตัวไปทั่วโลกได้อย่างไร หรือจะต้องเผชิญกับการควบคุมที่เข้มงวดขึ้นจากทั้งรัฐบาลและองค์กรต่าง ๆ ในอนาคต

ที่มา : techcrunch